灾难性遗忘是反向传播学习算法的一个固有问题,是人工和尖峰神经网络(ANN和SNN)研究中的一个具有挑战性的问题。

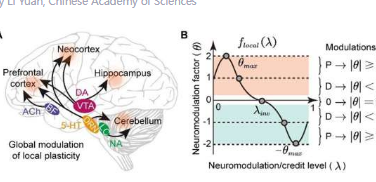

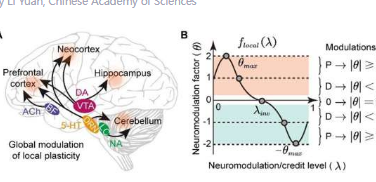

大脑利用多尺度可塑性在一定程度上解决了这个问题。在通过特定途径的全局调节下,神经调节剂分散到目标大脑区域,其中突触和神经元可塑性都受到神经调节剂的局部调节。具体来说,神经调节剂改变神经元和突触可塑性的能力和特性。这种改变被称为化塑性。

中国科学院自动化研究所徐波研究员及其合作者提出了一种基于神经调制依赖可塑性的新型类脑学习方法(NACA),有助于减轻ANN和SNN中的灾难性遗忘。该研究发表在8月25日的《科学进展》杂志上。

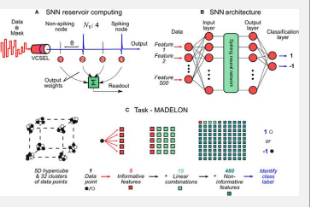

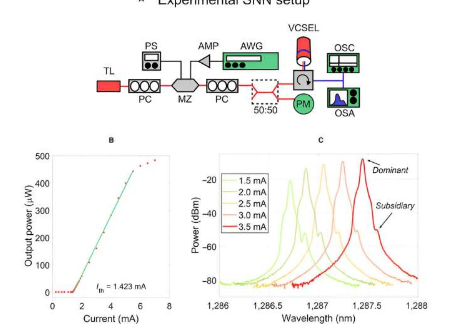

该方法基于大脑中复杂的神经调制通路的结构,并依赖于预期矩阵编码形式的神经调制通路的数学模型。接受刺激信号后,产生不同强度的多巴胺监督信号,进一步影响局部突触和神经元的可塑性。

NACA支持使用纯前馈流学习方法来训练ANN和SNN。通过全局多巴胺扩散支持,它与输入信号同步,甚至在输入信号之前向前传播信息。结合尖峰时间依赖性可塑性的选择性调整,NACA在快速收敛和减轻灾难性遗忘方面表现出显着的优势。

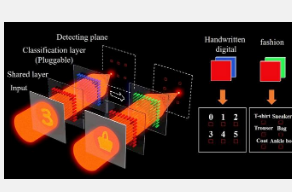

在两个典型的图像和语音模式识别任务中,研究团队评估了NACA算法的准确性和计算成本。在使用图像分类(MNIST)和语音识别(TIDigits)标准数据集的测试中,NACA实现了更高的分类准确率(约1.92%)和更低的学习能耗(约98%)。

此外,研究团队重点测试了NACA在课堂持续学习上的持续学习能力,并将神经调节扩展到神经元可塑性的范围。

在不同类别的五个主要连续学习任务中(包括连续MNIST手写数字、连续字母手写字母、连续MathGreek手写数学符号、连续Cifar-10自然图像和连续DvsGesture动态手势),NACA与反向传播相比表现出更低的能耗和弹性权重合并算法,可以极大地减轻灾难性遗忘问题。

NACA是一种生物学上合理的全局优化算法,它利用宏观可塑性来进一步 调节 局部可塑性,这可以被视为一种 可塑性的可塑性 方法,与 学会学习 和 元学习 具有直观的功能一致性, 徐教授说。

免责声明:本文由用户上传,如有侵权请联系删除!

标签: 上一篇太阳能水下航行器能否帮助我们更好地了解海洋 下一篇